Case: Fra 0 til 253 artikler på én dag med programmatisk SEO

Mette Tulin Antonsen

Med programmatisk SEO og AI kan man bygge en contentmaskine, der kører lige så hurtigt som en Porsche!

Det har jeg glædet mig til at teste. Så for nyligt besluttede jeg mig for at lave et eksperiment på Aquascapedia, hvor jeg kombinerer programmatisk SEO med AI for at skabe en masse unikke artikler i skala.

Og så er målet selvfølgelig også, at artiklerne skaber organisk trafik ved systematisk at dække mange potentielle søgninger i en ret specifik niche.

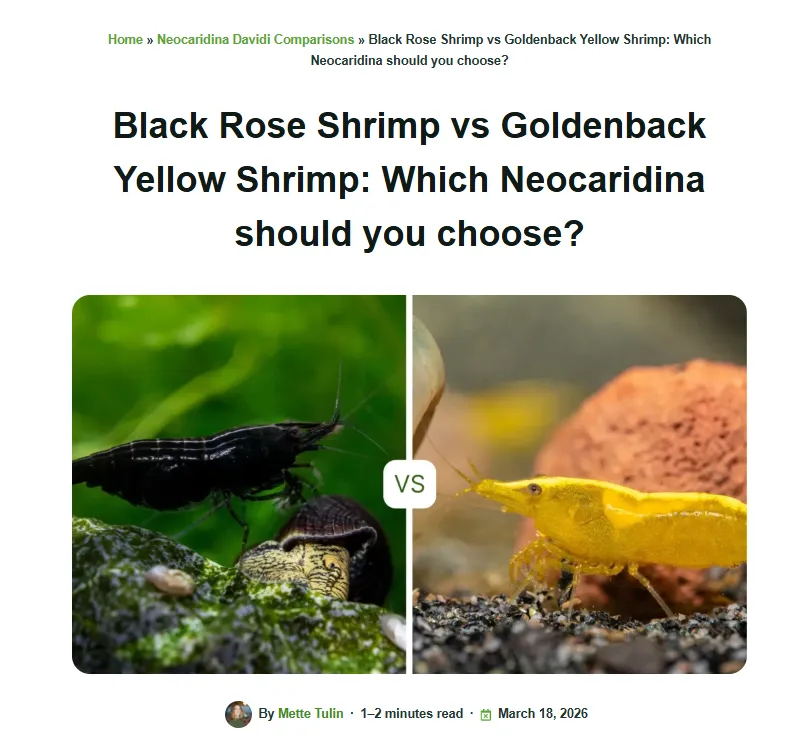

Casen tager udgangspunkt i 23 forskellige varianter af akvarierejen Neocaridina davidi, som jeg allerede har opbygget unikke profiler af på Aquascapedia. På baggrund af disse profiler genererer jeg programmatisk sammenligningssider på tværs af alle kombinationer.

Der findes mange farver, der har unikke navne, som f.eks. Red Cherry, Bloody Mary, Blue Velvet, Black Rose, Goldenback Yellow med flere.

En typisk side i setuppet er f.eks. denne:

Du kan se selve artiklerne her (dog har jeg ikke publiceret alle 253, da jeg publicerer dem løbende af hensyn til Google og indeksering).

I stedet for at tage udgangspunkt i klassisk søgeordsanalyse, startede jeg med et konkret dataset: 23 farvevarianter af Neocaridina-rejer. Ud fra dette dataset genererede jeg alle mulige parvise sammenligninger, hvilket resulterede i 253 unikke sider, hvor hver side sammenligner to varianter.

Sammenligningssider er nemlig særligt velegnede til programmatisk SEO, fordi de kan struktureres systematisk og skaleres gennem kombinationer af eksisterende datapunkter.

Mit fokus er altså ikke på enkelte søgeord, men på at opbygge et struktureret setup med data og templates, der gør det muligt at skalere produktionen af indhold effektivt.

Har du hænderne på rattet? Godt, så kører Porschen. Lad os se nærmere på setuppet.

Data

23 farvevarianter af Neocaridina davidi-rejer

Templates

Strukturerede sammenligningssider, der får indsat content automatisk via dynamisk indhold

Automation

n8n til at orkestrere hele workflowet, lige fra at generere kombinationer til at sende input til OpenAI og til sidst automatisk publicere indholdet på mit WordPress-site

AI

OpenAI GPT-4.1 mini (fordi den var billig og faktisk bedst efter et par sammenligninger med den dyrere GPT-5 mini)

Database

Neon (PostgreSQL) til at strukturere data og lave kombinationstabeller

Billeder

Figma Buzz til programmatisk generede coverbilleder

Bemærk, at selv et relativt lille dataset kan skaleres massivt med programmatisk SEO, når det kombineres med struktur, templates og automatisering.

Programmatisk SEO (eller programmatic SEO, pSEO, kært barn har flere navne) er ikke noget nyt. Det bygger på brugen af datasæt med det formål at skabe mange sider systematisk, og det fandtes længe før AI.

Men AI er et værktøj, der kan gøre processen både hurtigere og mere fleksibel. Det er i dag langt nemmere med sprogmodeller at generere varieret indhold i stor skala, mens det førhen var et problem, at man ofte fik enslydende og tyndt content.

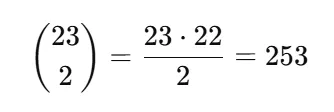

For at skalere setuppet brugte jeg en simpel kombinationslogik, hvor hver variant blev sammenlignet med alle andre. Jeg brugte selvfølgelig AI til at lave matematikken for mig, den ser sådan ud:

Med 23 profiler og sammenligninger mellem to forskellige varianter giver det 253 unikke kombinationer. Det er netop derfor, casen resulterede i 253 artikler.

En vigtig detalje i programmatisk SEO er nemlig at undgå dubletartikler. Vi vil nemlig ikke have både:

“Red Cherry Shrimp vs Bloody Mary Shrimp”

og

“Bloody Mary Shrimp vs Red Cherry Shrimp”

for de handler jo ultimativt om det samme. Så med AI-matematikken sikrede jeg, at hver sammenligning kun blev genereret én gang og undgår dermed dobbeltindhold.

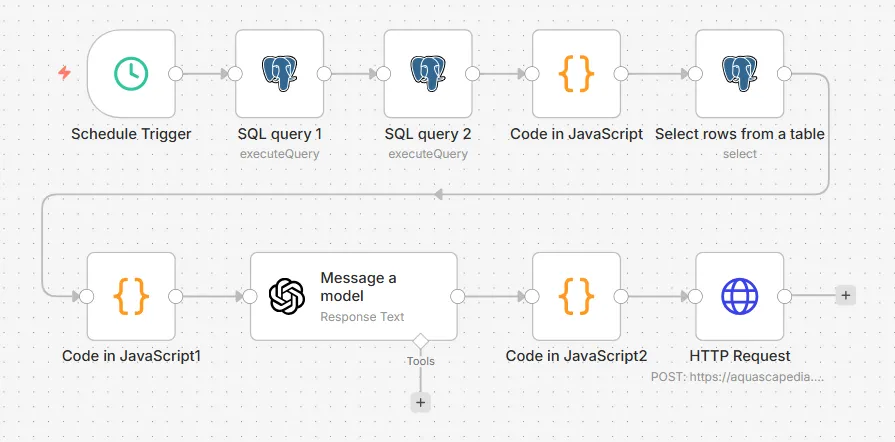

N8n er selvfølgelig min automatiseringsmotor og håndterer hele flowet. Det ser sådan ud:

Jeg samlede alt data i en Neon Postgres-database, hvor kombinationslogik og datamapping sørgede for, at alle sammenligninger blev genereret korrekt. Det er det, der foregår i mine SQL query- og code-noder.

N8n trækker information om det næste “par” af rejer, der skal skrives om, henter data og fodrer OpenAI med inputtet. Jeg valgte den model, fordi den både er billig og faktisk leverer bedre tekst (i mine tests), end den lidt dyrere GPT 5 Mini. En lille, men vigtig læring, for man kan godt få meget forskelligt output.

Selve siderne på mit website bliver genereret ved at indsætte indholdet i dynamiske templates, der sikrer struktur og ensartethed, men det smarte ved AI er, at den kan skabe variation, så siderne ikke føles som ren copy-paste. Når en tekst er klar, lægger n8n den automatisk ind på mit WordPress-site, komplet med formatering.

I det her setup er AI kun én del, nemlig selve tekstgenereringen, men det er datagrundlaget og automationsflowet, der driver hele maskinen.

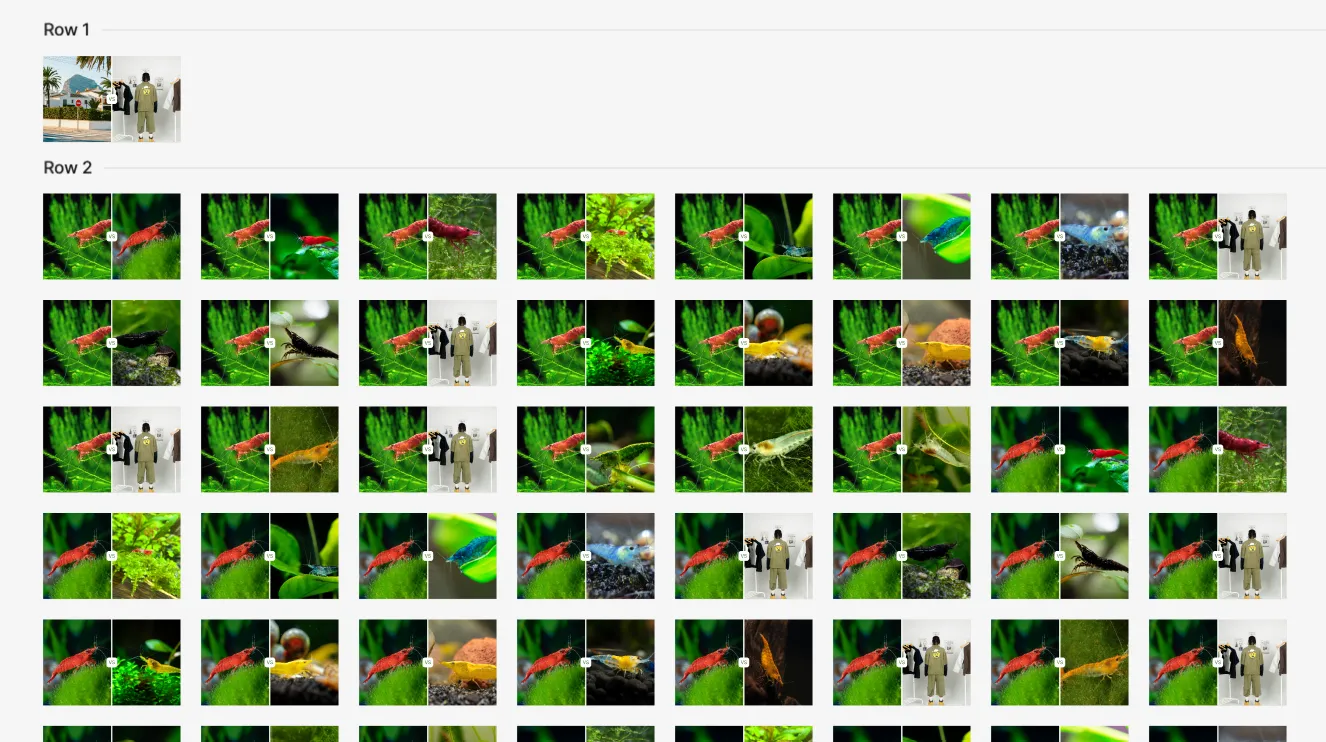

Da det kan være udfordrende at skabe unikt og engagerende indhold udelukkende gennem tekst, supplerede jeg med billeder. I stedet for AI-genererede visuals brugte jeg et struktureret billedsetup med fotos af hver farvevariant, som blev uploadet via et regneark i Figma Buzz.

Således blev hver rejevariant indsat i min template (Row 1 på billedet). Jeg mangler nogle farvevarianter, så derfor er pladsholder-billedet stadig på nogle af dem.

På den måde kunne jeg automatisk generere et coverbillede til hver side, hvor de to rejer, der sammenlignes, vises side om side med et tydeligt “versus”-element.

Det er en simpel løsning, men den øger både brugeroplevelsen og differentieringen mellem siderne. Og det reducerer samtidig risikoen for, at indholdet opfattes som for ensartet af Google.

Upload og tilknytning af billeder til de enkelte artikler blev desuden fuldt automatiseret via n8n, så jeg ikke manuelt skulle sidde og uploade 253 billeder.

Projektet er først og fremmest et eksperiment i skalering og indeksering. Det blev lanceret i marts 2026, og jeg vil løbende her på ai-mlab følge op med konkrete resultater i forhold til, hvor mange sider der bliver indekseret, samt hvor meget organisk trafik de genererer.

I stedet for at publicere alle 253 sider på én gang har jeg valgt at gå lidt mere forsigtigt til værks. Jeg har udgivet de 20 mest relevante sammenligninger og følger med i, hvordan Google reagerer på indholdet.

Det er i sidste ende Google, der fungerer som dommer, når man laver programmatisk SEO. Det er nemlig dem, der afgør, om siderne overhovedet bliver vist på Google.

Resten af siderne ruller jeg ud, når jeg kan se, at de første sider bliver indekseret.

I Google Search Console kan man følge, om ens sider bliver indekseret. Hvis en side står som “Discovered – not indexed”, betyder det, at Google har fundet siden, men aktivt valgt ikke at inkludere den i indekset.

Et centralt spørgsmål er derfor: Hvor mange af de 253 sider bliver faktisk indekseret?

Så det overvåger jeg løbende i Search Consolen. Her kan jeg se, hvilke sider der bliver indekseret, og hvilke der forbliver i “Discovered”-stadiet.

Det giver et klart billede af, hvor godt indholdet performer, og om det giver mening at skalere yderligere, eller om jeg skal justere siderne.

Et par læringer tager jeg med mig fra casen.

Ja! Programmatisk SEO er særligt relevant for virksomheder, der arbejder med store mængder struktureret data. Det gælder blandt andet SaaS-virksomheder, marketplaces, e-commerce og finansielle ydelser, hvor man kan skalere indhold baseret på produkter, features, lokationer eller prisdata.

Typiske use cases inkluderer sammenligningssider, produktkategorier, lokationssider, prisoversigter og feature-baserede landingssider, altså indhold, der kan systematiseres og gentages med variation.

Omvendt fungerer programmatisk SEO dårligere i cases, hvor indholdet kræver dyb faglighed, unikke perspektiver eller stærk redaktionel kvalitet, som ikke kan skaleres gennem templates og data alene.

Der er samtidig nogle risici forbundet med tilgangen, man bør være opmærksom på. Hvis man skalerer uden fokus på kvalitet og brugerintention, kan det føre til store mængder indhold, der ikke bliver indekseret. Derudover skal man være opmærksom på Googles spam policies samt risikoen for, at hvis man har for mange sider med lav værdi, svækker det sitets samlede performance.

Programmatisk SEO kan være enormt kraftfuldt i nogle tilfælde, men det er ikke altid en sikker genvej til trafik.

I dag er det helt vildt nemt at producere store mængder unikt indhold pga. AI, men i sidste ende er det stadig Google, der sætter standarden. Man kan bygge en Porsche af en contentmaskine, men det betyder ikke, at man bare kan træde speederen i bund og forvente, at vejen er fri.

Det bliver interessant at se, om mit setup med 253 sammenligningssider får momentum, eller om Google stopper det tidligt i processen. Indtil videre har eksperimentet bekræftet, at det er muligt at skabe mange unikke tekster med høj produktionshastighed, men også at det kræver finesse, tålmodighed og løbende overvågning at få det til at fungere i praksis.

Hvis du selv overvejer at arbejde med programmatisk SEO, vil min anbefaling være at starte småt, følge indekseringen tæt og justere løbende baseret på data. Det kan som sagt være et kraftfuldt værktøj, når det bruges rigtigt.

Måske sætter Google en stopper for Porschen, før den overhovedet har forladt indkørslen. Måske fræser den af sted med 253 km i timen. Det må tiden vise.